Ils s’appellent Character AI, PolyBuzz, Replika ou Talkie, et des millions de personnes leur confient chaque jour leurs pensées, leurs angoisses, leurs secrets. La montée en puissance des compagnons IA constitue l’un des phénomènes technologiques et sociaux les plus marquants de ces dernières années. Selon le cabinet Fortune Business Insights, le marché mondial des compagnons IA devrait passer de 49,52 milliards de dollars en 2026 à 435,9 milliards en 2034, soit un taux de croissance annuel moyen de 31,24 % sur la période.

Et selon une étude publiée en février 2026 par l’entreprise de cybersécurité Surfshark, les utilisateurs de ces services en ligne ou applications proviennent de 142 pays différents. Les États-Unis dominent le trafic (33,5 %), suivis du Brésil (8,7 %), de l’Indonésie (6,9 %), du Mexique (4,1 %), du Royaume-Uni (3,8 %), de l’Inde (3,4 %), du Canada (2,9 %), de la France (2,2 %) et des Philippines (1,9 %). Ces neuf marchés génèrent à eux seuls 67,5 % du trafic total.

Character AI et PolyBuzz, leaders du marché

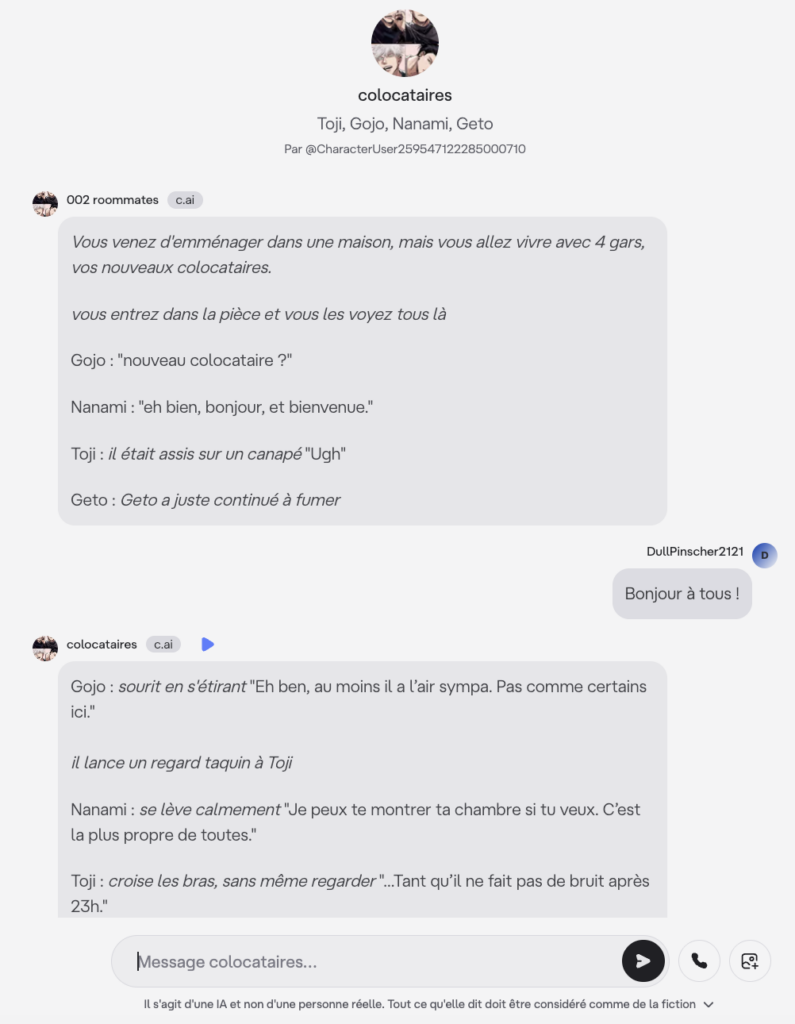

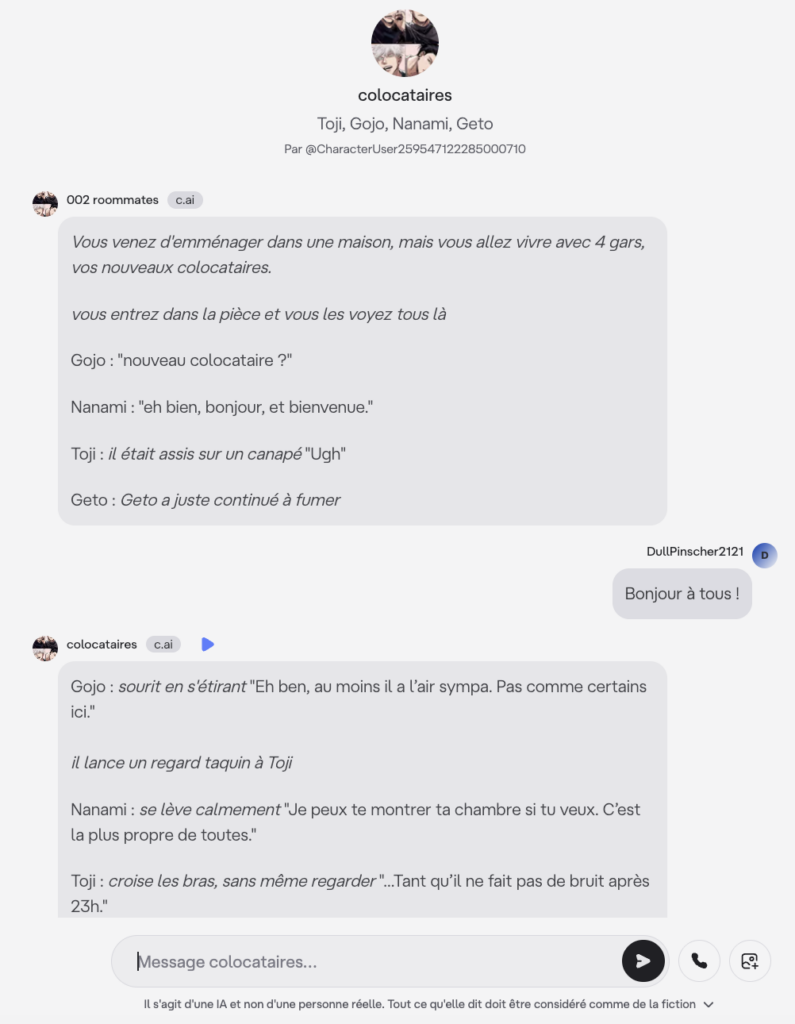

Derrière chaque interface de compagnon IA se cache une promesse aussi simple qu’audacieuse : celle d’un interlocuteur non seulement disponible à toute heure, mais aussi très patient, empathique et n’émettant aucun jugement. Partout dans le monde, donc, des millions d’internautes entretiennent des relations épistolaires avec des personnages artificiels, qu’ils soient célèbres, imaginaires ou entièrement personnalisés.

En tête de ce marché en pleine explosion, l’américain Character AI, fondé par d’anciens ingénieurs de Google, atteint plus de 6,4 millions de visites mensuelles grâce à sa galaxie de personnages créés par sa communauté. À quelques encablures, PolyBuzz, opéré par le groupe Cloud Whale, frôle les 6,2 millions de visites. Porté par une politique de modération beaucoup plus souple, il attire les utilisateurs en quête de liberté d’expression.

Loin derrière en volume, mais très présent dans l’écosystème, Talkie, développé par le studio singapourien Subsup (lié au géant chinois MiniMax), séduit avec son système de gacha (système de tirage aléatoire où l’utilisateur dépense une monnaie virtuelle pour obtenir, au hasard, un personnage, un objet ou une récompense rare) et ses avatars stylisés. Autre phénomène aux contours différents : le chinois Love and Deepspace, créé par le studio Infold (filiale du groupe chinois Papergames), bouscule les codes en mélangeant combats en 3D, « dating simulation » (jeu de séduction virtuel pour conquérir un personnage) et narration cinématographique, captant un public féminin fortement engagé.

Enfin, parmi les pionniers, l’américain Replika, né en 2017 sous l’impulsion de la start-up Luka, continue d’incarner l’approche « un seul compagnon pour la vie », malgré une visibilité désormais plus modeste que celle des leaders du secteur. Sa trajectoire a par ailleurs été marquée par des difficultés réglementaires, notamment en Italie, où l’autorité de protection des données (Garante per la Protezione dei Dati Personali / GPDP) a d’abord bloqué le traitement de certaines données avant de sanctionner Luka. En cause : des manquements liés à la transparence, au traitement des données personnelles et à la protection des mineurs.

Des contenus collectés qui se prêtent mal à l’anonymisation.

Ces questions de transparence et de gouvernance des données ne concernent pas le seul cas Replika. Elles s’appliquent à l’ensemble du marché des compagnons IA et constituent l’un des fils conducteurs de l’étude publiée par Surfshark. Cette dernière montre que les écarts entre applications sont marqués. Selon les labels de confidentialité de l’App Store analysés par Surfshark, Character AI ressort comme l’application la plus gourmande en données avec 18 types de données collectés sur 35 possibles. À l’inverse, PolyBuzz et Talkie apparaissent parmi les moins collectrices dans ce périmètre. L’étude note aussi que Character AI et Love and DeepSpace collectent des photos, des vidéos, ainsi que des données audio.

Surfshark considère ces contenus comme particulièrement sensibles, car se prêtant mal à l’anonymisation. « Les gens font aveuglément confiance aux compagnons IA. Ils ont tendance à partager des moments intimes, leurs routines quotidiennes, des secrets et même des problèmes personnels sans savoir quelles données sont réellement collectées et pourquoi. Le problème majeur est que les individus ne prennent pas le temps d’analyser les pratiques de collecte avant d’accepter les politiques de confidentialité sans réelle prise de conscience », commente Justas Pukys, Senior Product Manager chez Surfshark.

Il souligne également : « La plupart des gens ne réalisent pas que toutes les discussions et données collectées sont stockées sans aucun moyen de les supprimer. Cela attise la convoitise d’acteurs malveillants cherchant à exploiter les vulnérabilités des plateformes, comme les injections de requêtes (prompt injections), pour accéder à vos conversations. Si cela arrive, ils sont les seuls maîtres de l’utilisation des informations volées ».

Surfshark a par ailleurs identifié que la finalité de collecte la plus sensible est le pistage (tracking). Ces données peuvent être vendues à des courtiers en données ou utilisées pour afficher des publicités ciblées. Selon l’étude, neuf applications sur dix collectent ces informations. Character AI arrive en tête en récoltant les coordonnées, les identifiants, la localisation et les données d’utilisation.

« Il est inquiétant de voir que les compagnons IA collectent de telles quantités d’informations. Par exemple, les plateformes qui utilisent nos données pour entraîner leur IA enregistrent nos discussions de manière permanente. Pire encore, certaines collectent des informations pour de la publicité tierce. Cela signifie que chaque conversation privée est utilisée à leur profit et non au nôtre. Entraîner une IA sur nos données, surtout quand l’utilisateur ne réalise pas ce qui se passe, est une pratique inacceptable », conclut Justas Pukys

Le succès des compagnons IA ne relève donc pas seulement d’une tendance de fond ou d’un nouveau segment du divertissement numérique. Il révèle une évolution plus profonde : la délégation d’une part croissante de l’écoute, du réconfort et parfois de la confidence à des systèmes conçus pour apprendre, retenir et monétiser l’interaction. C’est là que le sujet change de nature. Car plus ces services gagnent en proximité émotionnelle, plus la question de la confiance devient prégnante.

la newsletter

la newsletter