- Accueil

- Gestion des risques

- Intelligence artificielle : le monde prend conscience de ses risques

Intelligence artificielle : le monde prend conscience de ses risques

Nous venons de vivre une semaine intense dans le « monde » de l’intelligence artificielle (IA). En quelques jours, de prestigieuses organisations ont publié cinq documents abordant tous le thème de l’IA et ses risques pour l’humanité. S’agit-il d’une coïncidence ? Certainement pas.

Tous ces documents font référence aux risques liés à l’Artificial General Intelligence (AGI), soit le niveau 2 de l’IA. L’intelligence artificielle d’aujourd’hui, comprenant l’IA générative telle que ChatGPT, correspond à l’Artificial Narrow Intelligence (ANI), soit le niveau 1. Cette même intelligence artificielle a la capacité de faire aussi bien voire mieux que l’homme, pour une seule activité.

L’AGI et son successeur de niveau 3, l’ASI (Artificial Super Intelligence), proposent des IA capables d’accomplir toutes les activités informationnelles, d’une qualité égale voire supérieure à ce que peuvent produire les humains. Actuellement, le consensus des experts revient à dire que l’AGI pourrait arriver entre 2030 et 2040. C’est demain, en somme.

Ces documents évoquent des risques majeurs pour l’humanité. Ont-ils cependant raison de nous alerter sur ces dangers ? Ma réponse est clairement oui. Je vous encourage vivement à lire ces cinq documents, mais si vous ne deviez en lire qu’un seul, ce serait celui de ce groupe de 30 experts.

Cet extrait est révélateur du ton général du document : « AI advancement could culminate in a large-scale loss of life and the biosphere, and the marginalization or even extinction of humanity ». On y évoque « tranquillement » l’extinction de l’humanité ! Les trois documents qui suivent se ressemblent beaucoup. Il s’agit en effet de déclarations d’intention très générales, pleines de bons sentiments, mais à la portée réelle proche de zéro.

Ils ont été publiés par les Nations unies, le G7 et lors du Bletchley Summit declaration. Cette réunion internationale, organisée par le Royaume-Uni, a eu lieu le 1er et 2 novembre 2023.

Personne n’ira à l’encontre des idées exprimées dans la déclaration de Bletchley, signée par 28 États aux intérêts très divergents : États-Unis, Chine, Inde, Israël, Arabie Saoudite et l’Union européenne : « La reconnaissance de la nécessité de prendre en compte la protection des droits de l’homme, la transparence et l’explicabilité, l’équité, la responsabilité, la réglementation, la sécurité, la surveillance humaine appropriée, l’éthique, l’atténuation des préjugés, le respect de la vie privée et la protection des données. »

Quant au cinquième document, il est, lui, d’une toute autre nature. C’est un décret signé par Joe Biden, le 30 octobre 2023. En 60 pages, le président des États-Unis liste des centaines d’actions précises à mener. Pour chacune d’entre elles, les organismes publics chargés de les exécuter sont désignés. Le calendrier est de surcroît contraignant car les délais annoncés vont de 45 à 365 jours pour la majorité de ces actions. On est loin d’un catalogue de bonnes intentions. On y trouve la volonté clairement affichée des États-Unis de tout faire pour garder leur leadership mondial sur l’IA.

Dans ce concert de recommandations, où en est l’Europe ?

La Commission européenne travaille sur le sujet de l’IA depuis 2020. En juin 2023, elle a publié un document sur l’état d’avancement (EU Legislation in Progress) d’un Artificial Intelligence Act (AIA) Européen, un « Act » de plus après le DSA (Digital Service Act) et le DMA (Digital Market Act). Cet AIA doit maintenant être soumis à tous les États membres qui pourront y apporter des modifications avant son approbation définitive. Nul ne sait combien de temps cela prendra.

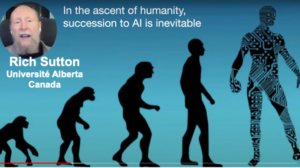

Peut-on, en synthèse, imaginer quel pourrait être le futur d’une collaboration entre l’humanité et des AGI et ASI ? Si l’on en croit Rich Sutton, professeur à l’Université d’Alberta au Canada, spécialiste reconnu de l’IA, l’humanité doit se préparer à passer la main à l’IA, et ce serait inévitable, comme le montre ce schéma tiré d’une de ses récentes conférences.

Ma recommandation : les défis posés par l’arrivée rapide des AGI et ASI font partie des questions auxquelles tous les dirigeants des organisations, publiques et privées, doivent réfléchir rapidement.

D’ailleurs, on pose souvent cette question aux meilleurs spécialistes de l’IA : Quel peut être l’avenir de l’humanité dans un monde où l’IA deviendra plus performante que les humains ? La réponse récurrente : « Je ne sais pas. » Ce n’est pas pour autant qu’il ne faut pas y réfléchir, tous et très vite.

la newsletter

la newsletter

![Image Pourquoi [Mythos] signe la fin du patch management traditionnel](https://incyber.org//wp-content/uploads/2025/06/istock-1384205321-885x690.jpg)